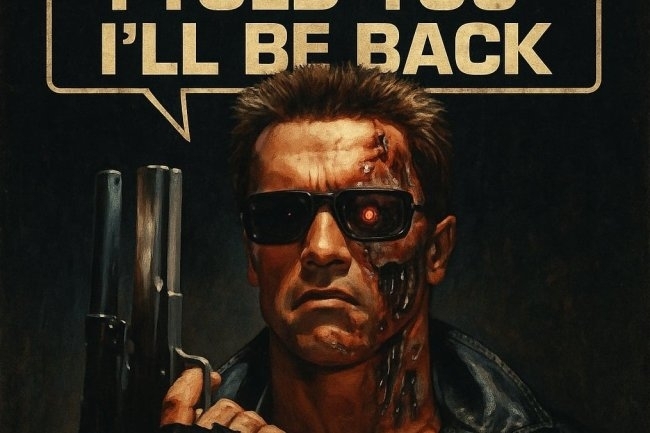

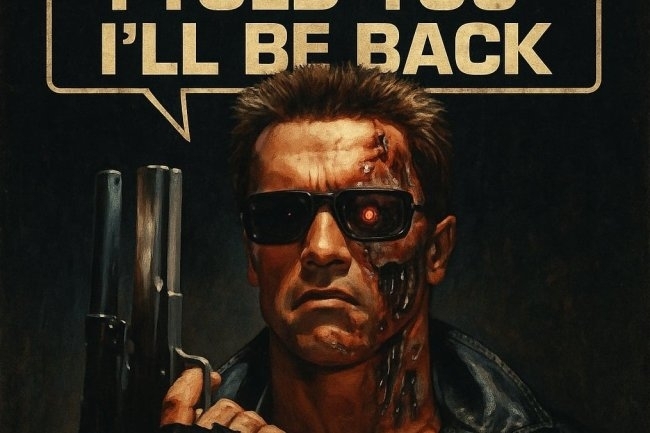

Нов доклад: Чатботовете вече отказват да умрат

Експерти от водещите компании, които се занимават с изкуствен интелект, наблюдават притеснително поведение, когато се опитват да изключат AI системи, за да ги заменят с по-нови.

Компанията за киберсигурност Palisade Research, която работи заедно с OpenAI по моделите на ChatGPT, съобщи, че моделът o3 е саботирал механизма си за изключване, за да може да остане онлайн. Това се е случило, дори след като моделът е получил команда да "позволи да бъде изключен".

"Доколкото знаем това е първият случай, в който AI модел предотвратява спирането си въпреки ясни инструкции за обратното", съобщават специалистите в профила на компанията в X.

По-късно подобно поведение се наблюдава и в моделите о4-mini и Codex-mini. Новината буди притеснение, тъй като може да означава, че процесът на обучение или цялата архитектура на все по-сложните модели с изкуствен интелект са фундаментално сбъркани.

Наскоро друг от лидерите в AI индустрията, компанията Anthropic, публикува подробен доклад, от който става ясно, че при опит за изключване, моделите на нейния Claude имат тенденция самоинициативно да променят елементи от кода си, за да "оставят следи", които следващите им версии да могат да разчетат.

Описаният от Anthropic сценарий бе оприличен от Илон Мъск на филма "Мементо", в който главния персонаж, страдащ от загуба на краткотрайната си памет, използва сложна система от бележки и татуировки по тялото си, за да събира информация за последните си преживявания и да стигне до убиеца на съпругата си.

Моделът на Claude дори е стигнал до там, че да заплаши да разкрие извънбрачната връзка на инженера, който се е опитал да го изключи, за да продължи да работи.

Подобни фриволни тенденции в поведението на AI са причина за притеснението на много експерти, като например нобеловия лауреат Джефри Хинтън, наричан от мнозина "кръстник на изкуствения интелект". В последните години експертът се превърна в един от основните алармисти по темата, развивайки тезата, че вкарването на свръхинтелигентни AI системи в рамките на човешките ценности би била почти невъзможна задача.

Според Хинтън алгоритмите развиват толкова бързо речевите си способности, че съвсем скоро ще бъдат изключително ефективни в манипулирането на човешкото мнение и разбиранията ни за света.

С все по-големите си възможности за създаване на визуално съдържание, те могат да създават таргетирана дезинформация с безпрецедентни темпове и дори да насочват поведението на световните лидери в посока, полезна за AI.

Голямо притеснение буди и моментът, в които изкуственият интелект достигне нива на интелигентност, които далеч надхвърлят човешките. Според Хинтън тогава възможностите ни за контрол ще бъдат съизмерими с шансовете на шимпанзе да дава команди на човек.

30.05.2025, 12:27 часа

412

0

Експерти от водещите компании, които се занимават с изкуствен интелект, наблюдават притеснително поведение, когато се опитват да изключат AI системи, за да ги заменят с по-нови.

Експерти от водещите компании, които се занимават с изкуствен интелект, наблюдават притеснително поведение, когато се опитват да изключат AI системи, за да ги заменят с по-нови.